Dlaczego zgodność z normami jakości i regulacjami wymaga dziś wsparcia AI

Rosnąca złożoność norm i regulacji a codzienność zakładu

Systemy jakości jeszcze kilkanaście lat temu opierały się głównie na ISO 9001 i kilku prostych procedurach. Dziś przeciętny zakład przemysłowy funkcjonuje w gąszczu wymagań: ISO 9001, ISO 14001, ISO 45001, branżowych IATF 16949, ISO 13485, GMP, HACCP, norm bezpieczeństwa funkcjonalnego, a do tego dochodzą regulacje MDR, FDA, lokalne prawo, wymagania klientów i korporacyjne standardy grupy. Każdy z tych dokumentów niesie ze sobą setki punktów, zapisów i warunków, które trzeba nie tylko „mieć na papierze”, ale także realnie spełniać na hali.

Tradycyjne podejście – segregator, formularz, Excel – coraz częściej pęka w szwach. Kontrola zgodności z normami jakości ISO i regulacjami branżowymi wymaga śledzenia tysięcy powiązanych rekordów: parametrów procesów, materiałów, kwalifikacji operatorów, kalibracji, reklamacji, zmian w dokumentacji. Bez narzędzi opartych na AI większość informacji pozostaje martwymi danymi – gdzieś w systemach, ale poza realnym nadzorem.

AI nie jest „magiczną różdżką”, która rozwiązuje problem złożoności. Jest natomiast rozszerzeniem ludzkiej percepcji i czasu: potrafi w kilka sekund przeanalizować wolumen danych, który zespołowi jakości zająłby dni albo tygodnie. To oznacza szybsze wykrywanie niezgodności, lepsze zrozumienie ryzyka i bardziej wiarygodne dowody dla audytora.

Eksplozja danych produkcyjnych i jakościowych

Przemysł 4.0 spowodował, że praktycznie każda maszyna generuje dane: temperatury, ciśnienia, czasy cyklu, alarmy, wyniki pomiarów, obrazy z kamer wizyjnych. Systemy MES, SCADA, LIMS i QMS gromadzą informacje o partiach, zmianach, operatorach, wynikach kontroli, reklamacjach, działaniach korygujących. Problem nie polega już na tym, że danych brakuje – przeciwnie, jest ich tak dużo, że bez AI trudno z nich wyłuskać sens.

Excel jest dobry przy kilkuset wierszach. Przy milionach rekordów, wielowymiarowych zależnościach między parametrami procesu a jakością wyrobu zaczyna się loteria. Wystarczy kilka nieliniowych zależności lub opóźnione efekty (np. jakość partii zależna od surowca z poprzedniego tygodnia), aby klasyczne narzędzia SPC przestały wystarczać. Modele uczenia maszynowego potrafią wychwycić subtelne korelacje i wzorce, które są niewidoczne w prostych wykresach.

Mit, że „do SPC wystarczy Minitab i kartka papieru”, sprawdza się tylko przy stabilnych, prostych procesach. W wieloetapowej produkcji z setkami zmiennych to, czy zakład utrzyma zgodność z wymaganiami IATF, ISO 13485 czy GMP, zależy coraz częściej od tego, czy potrafi efektywnie przetworzyć dane, a to wymaga algorytmów AI.

„Zgodność to papierologia” – mit kontra praktyka

Popularne przekonanie głosi, że compliance to głównie papiery, formularze i podpisy. W praktyce audytorzy – zarówno od ISO, jak i z FDA czy jednostek notyfikowanych – coraz mocniej patrzą na spójność danych i dowodów, a nie na samą formę dokumentu. Dokumentacja może wyglądać idealnie, a jednocześnie być oderwana od rzeczywistych danych z maszyn, laboratorium czy systemu reklamacji.

AI pomaga przejść z logiki „papier mówi, że wszystko jest OK” do logiki „dane pokazują, że proces jest pod kontrolą”. Modele analizujące trendy, odchylenia i anomalie potrafią wskazać obszary, gdzie procedura istnieje tylko teoretycznie. Dla audytora to jasny sygnał, że system zarządzania jakością jest żywy, a nie sztucznie podtrzymywany pod audyt.

Rzeczywistość jest taka, że najlepsze efekty daje połączenie: dobrze opisane procesy (normy tego wymagają) plus cyfrowe dowody z systemów i AI. Same formularze już nie wystarczą, a „papierologia” zamienia się w data-driven compliance.

Postawa audytorów wobec AI – co się naprawdę liczy

Kolejny mit mówi, że audytor „nie lubi AI”, bo to nowinka i „czarna skrzynka”. Tymczasem coraz częściej audytorzy wręcz oczekują świadomego wykorzystania danych i narzędzi analitycznych. Kluczowe są trzy elementy: transparentność działania, możliwość odtworzenia decyzji oraz wiarygodne dane wejściowe.

Jeżeli zakład potrafi wyjaśnić, jakie dane zasilały model, jak przebiegała walidacja, jakie progi alarmowe przyjęto i jak wyniki są wykorzystywane w procesie (np. inicjowanie działań korygujących), audytor zazwyczaj ocenia AI jako silne wsparcie systemu jakości. Problem pojawia się dopiero wtedy, gdy organizacja „chowa się za AI”, nie potrafi wytłumaczyć zasad działania albo nie ma nad tym narzędziem żadnego nadzoru.

Audytor nie wymaga, aby inżynier jakości był doktorem informatyki. Wymaga natomiast, aby zarządzanie AI było podobne do zarządzania innym wyposażeniem do monitorowania i pomiarów: określonym celem, zakresem, odpowiedzialnością, walidacją, nadzorem nad zmianami i zapisami.

Podstawy – jak rozumieć AI w kontekście norm ISO i regulacji

Model AI jako „wirtualny operator” w systemie jakości

Z perspektywy ISO 9001 i pokrewnych norm sztuczna inteligencja to nic innego jak środek nadzorowania procesu. Model może pełnić rolę wirtualnego operatora, który obserwuje dane z maszyn, klasyfikuje produkty, wskazuje odchylenia i sugeruje działania. Tak jak operator musi mieć kompetencje, zakres odpowiedzialności i szkolenie, tak model AI powinien mieć jasno zdefiniowany cel, granice działania oraz nadzór.

W systemie zarządzania jakością model AI można traktować jak połączenie narzędzia pomiarowego i procesu pomocniczego. Wpisuje się to w wymagania dotyczące nadzoru nad wyposażeniem do monitorowania i pomiarów (np. w ISO 9001, ISO 13485, IATF 16949). Oczekiwane są więc: walidacja, kalibracja (w sensie rewalidacji na danych), ocena niepewności decyzji oraz zapisy z wyników działania.

Dobre podejście polega na opisaniu modelu AI w dokumentacji systemu tak, jak opisuje się maszynę kontrolną lub system pomiarowy: co mierzy, z jaką dokładnością, jakie są kryteria przyjęcia/odrzutu i kto odpowiada za przegląd wyników.

Automatyzacja reguł vs AI ucząca się – różnica istotna dla audytora

W wielu zakładach myli się dwa światy: klasyczne systemy regułowe (IF-THEN) z rzeczywistą AI. Regułowa automatyzacja polega na tym, że inżynier zapisuje zasady: „jeżeli temperatura > X i ciśnienie < Y, zgłoś alarm”. Takie reguły są łatwe do audytowania, ale słabo skalowalne i nie wychwytują subtelnych wzorców.

Modele ML/AI (np. drzewa decyzyjne, sieci neuronowe, modele anomalii) nie są programowane regułami, lecz uczą się na danych historycznych. Dla audytora różnica jest kluczowa: w AI granica między „programem” a „ustawieniami procesu” jest płynna, bo zmianę danych treningowych można traktować jak zmianę konfiguracji wyposażenia pomiarowego.

To właśnie dlatego wymaga się walidacji modeli, wersjonowania i nadzoru nad zmianami. Przy systemie regułowym wystarczy udokumentować logikę i testy. Przy modelu uczącym się trzeba dodatkowo pokazać proces uczenia, zestaw testowy, wyniki metryk (np. dokładność klasyfikacji wad) oraz sposób rewalidacji przy nowych danych.

„Source of truth”: systemy bazowe a „nakładka” AI

W większości zakładów pewne systemy są traktowane jako jedyne źródło prawdy: ERP dla zamówień i partii, MES dla przebiegu produkcji, LIMS dla wyników laboratoryjnych, QMS dla reklamacji i działań korygujących. AI powinna działać na tych danych, a nie obok nich, tworząc równoległą, niespójną rzeczywistość.

Dlatego w dobrze zaprojektowanej architekturze AI jest warstwą analizującą: pobiera dane z systemów bazowych, przetwarza je, generuje wskazania czy rekomendacje, a wyniki z powrotem zapisuje do systemów uznanych za „source of truth”. Dzięki temu podczas audytu można prześledzić całą ścieżkę: od surowych danych, przez wnioski AI, po działania operatora i zapisy w QMS.

Rozproszone Excela, „bokami” wywożone logi z maszyn i modele AI działające na prywatnych laptopach działu utrzymania ruchu to prosta droga do chaosu. Dla zgodności z ISO i regulacjami branżowymi istotna jest spójność i jednoznaczność danych, a to wymaga centralnej koncepcji źródeł prawdy i integracji AI z tymi systemami.

Mity o AI w zgodności: samoczynna magia i „czarna skrzynka”

Mit pierwszy: „AI sama zapewni zgodność z ISO i regulacjami”. W rzeczywistości AI wzmacnia to, co już istnieje. Jeżeli procesy są chaotyczne, dane brudne, a odpowiedzialności rozmyte, model AI co najwyżej szybciej pokaże ten chaos. Nie zastąpi kontekstu organizacji, przeglądu zarządzania ani kultury jakości.

Mit drugi: „AI jest zbyt czarną skrzynką, by ją audytować”. W praktyce większość stosowanych w przemyśle modeli to algorytmy, które można wyjaśnić: drzewa, lasy losowe, modele anomalii z progami, nawet sieci neuronowe z warstwami pozwalającymi na interpretację wpływu poszczególnych zmiennych. Audytor oczekuje zrozumiałej dokumentacji, nie pełnej rozprawy naukowej.

Rzeczywisty problem pojawia się dopiero wtedy, gdy organizacja używa AI bez świadomości: bez opisu, bez odpowiedzialności, bez walidacji. Sam fakt użycia AI nie jest przeszkodą dla ISO, MDR czy FDA. Przeszkodą jest brak dowodów, że to narzędzie jest pod kontrolą.

Gdzie AI naprawdę pomaga w ISO i regulacjach – kluczowe obszary zastosowań

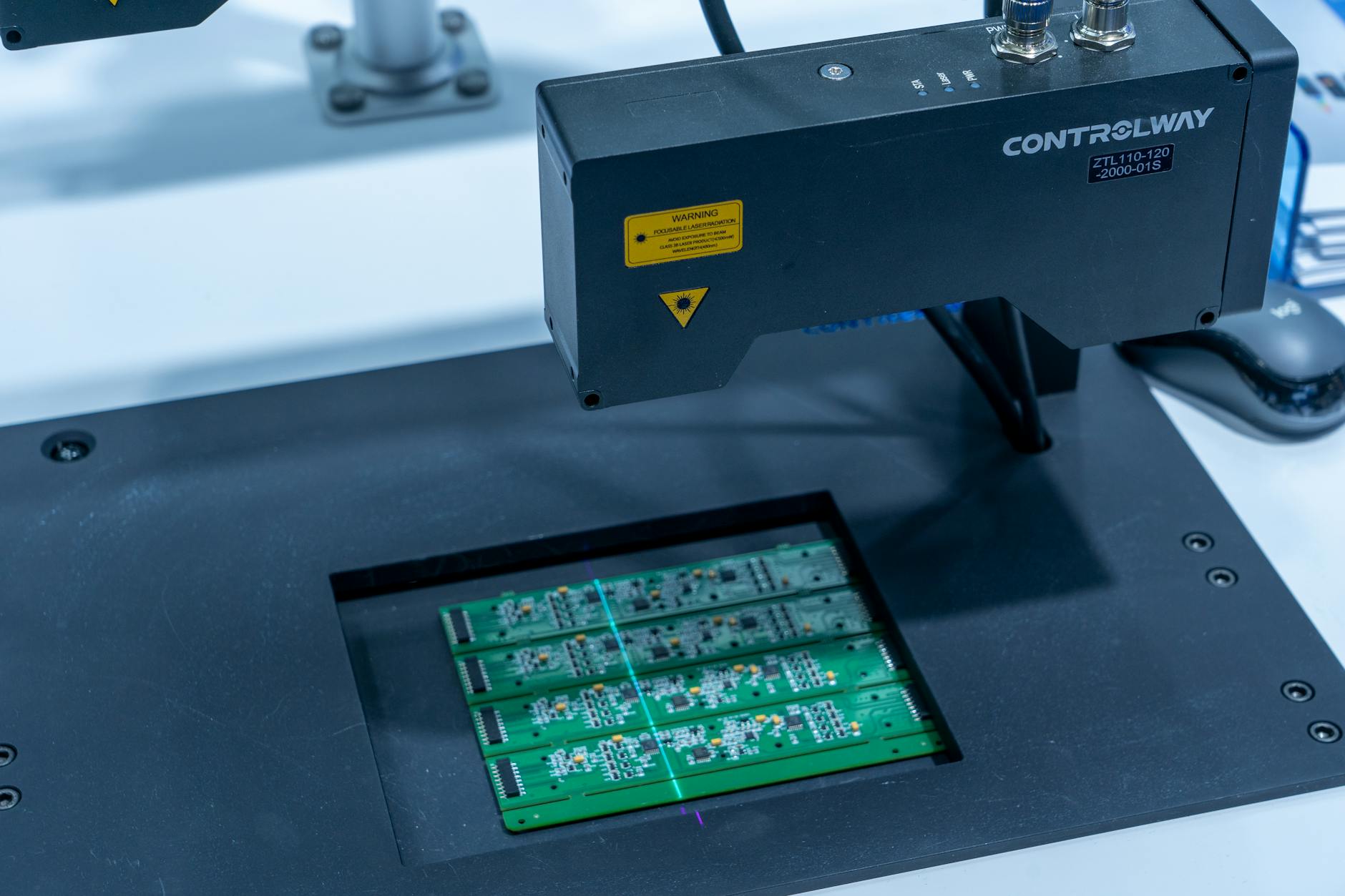

Monitorowanie procesów w czasie rzeczywistym: SPC + AI

Statystyczna kontrola procesu (SPC) jest dobrze znana z norm branżowych, takich jak IATF 16949. W praktyce jednak wiele kart kontrolnych prowadzi się ręcznie lub półautomatycznie, z opóźnieniem. AI pozwala przejść z biernego rejestrowania danych do aktywnego monitoringu w czasie rzeczywistym.

Modele anomalii wykrywają nietypowe kombinacje parametrów, które jeszcze nie przekraczają granic specyfikacji, ale wskazują, że proces zbliża się do stanu niestabilności. Przykład: linia montażowa, na której wahania momentu dokręcania śrub, temperatury i czasu cyklu razem tworzą wzorzec prowadzący po kilku godzinach do niezgodności. Człowiek widzi pojedyncze parametry, AI widzi ich kombinację.

Przewagą takiego podejścia jest to, że AI nie zastępuje klasycznych wskaźników Cp, Cpk czy kart X-bar. Jest warstwą nad nimi: sygnalizuje, że mimo formalnej zgodności z kartami, proces zaczyna pracować „miękko” – na granicy stabilności. Dział jakości i produkcji zyskuje czas na reakcję zanim pojawią się niezgodne partie.

Analiza przyczyn niezgodności i reklamacji z wykorzystaniem AI

Analiza przyczyn źródłowych (RCA) często kończy się na kilku powtarzalnych hasłach: „błąd ludzki”, „niedostateczne szkolenie”, „niezidentyfikowane zakłócenie”. AI pozwala wejść poziom głębiej, o ile zakład dysponuje danymi z reklamacji, niezgodności, parametrów procesów i warunków otoczenia.

Uczenie maszynowe potrafi łączyć przyczyny z efektami w sposób nieliniowy. Może się okazać, że określony typ wady częściej występuje przy konkretnym dostawcy surowca, w weekendowe zmiany lub w określonej kombinacji ustawień maszyn. Modele klasyfikacyjne wskazują zmienne, które najsilniej wpływają na wystąpienie wady.

Dodatkowo narzędzia NLP (przetwarzanie języka naturalnego) analizują opisy reklamacji, notatki z kontroli wejściowej czy protokoły serwisowe. Potrafią grupować podobne przypadki, wykrywać powtarzające się wzorce słów („pęknięcie przy spawie”, „wyciek na łączeniu”) i wiązać je z konkretnymi partiami, maszynami lub dostawcami. To przekłada się na skuteczniejsze działania korygujące, co jest sednem zgodności z ISO 9001, IATF czy ISO 13485.

Automatyzacja i porządkowanie dokumentacji ISO

Jednym z najbardziej „niewdzięcznych” obszarów jest dokumentacja: procedury, instrukcje, zapisy z inspekcji, potwierdzenia szkoleń, protokoły walidacji. AI usprawnia kilka kluczowych aspektów:

- Klasyfikacja i wersjonowanie dokumentów – modele rozpoznają typ dokumentu (procedura, zapis, raport CAPA), wersję, obowiązywanie na danym stanowisku.

- Wyszukiwanie kontekstowe – pracownik wpisuje „czyszczenie głowicy dozującej” i otrzymuje właściwą instrukcję, aktualną wersję i powiązane zapisy z ostatnich kontroli.

- Spójność zapisów – AI wykrywa niespójności: np. szkolenia wykonane na niewłaściwej wersji procedury, brak podpisu osoby uprawnionej, rozbieżność dat między rejestrami.

Regulacje takie jak FDA 21 CFR Part 11 wymagają nadzoru nad dokumentacją elektroniczną i podpisami. AI może wspierać sprawdzanie kompletności rekordów, wykrywać anomalie w logach (np. nieautoryzowany dostęp) i sygnalizować potencjalne naruszenia integralności danych. To bezpośrednio wpływa na utrzymanie zgodności i minimalizację ryzyka podczas inspekcji.

Traceability i łączenie danych z całego łańcucha

Łańcuch dostaw i traceability wspierane przez AI

Śledzenie partii od surowca po gotowy wyrób to jeden z kluczowych wymogów norm branżowych (IATF 16949, ISO 22000, ISO 13485) oraz regulacji FDA czy MDR. Ręczne łączenie identyfikatorów partii, numerów seryjnych i zapisów z wielu systemów kończy się często na ogromnych arkuszach Excel i nerwowym szukaniu informacji podczas reklamacji lub audytu. AI pomaga przede wszystkim w „zszywaniu” rozproszonych danych w spójne ścieżki traceability.

Modele dopasowujące (entity matching) potrafią wiązać rekordy po wielu atrybutach jednocześnie: numer partii, czas produkcji, linię, maszynę, operatora, parametry procesu, identyfikator dostawy. Gdy w jednym systemie brakuje numeru partii, ale jest dokładny timestamp i numer zmiany, a w innym – numer partii, ale przybliżony czas, AI potrafi z dużym prawdopodobieństwem połączyć te dane. Człowiek robi to ręcznie, powoli i z dużym ryzykiem pomyłki; model robi to systemowo i powtarzalnie.

Drugi obszar to automatyczne wykrywanie „dziur” w traceability. System AI może codziennie skanować rejestry i oznaczać sytuacje, w których:

- brakuje powiązania między dostawą surowca a partią produkcyjną,

- część partii nie ma przypisanych wyników testów końcowych,

- raport reklamacji nie został powiązany z konkretnymi numerami seryjnymi.

Zamiast dowiadywać się o brakach przy audycie lub poważnej reklamacji, dział jakości dostaje listę luk do uzupełnienia z wyprzedzeniem. To nie jest „magiczne domykanie traceability” przez AI, ale bardzo pragmatyczne narzędzie czyszczące i uszczelniające łańcuch danych.

Częsty mit brzmi: „jeśli wdrożymy AI, nie będziemy musieli pilnować identyfikowalności – system sam to załatwi”. W praktyce jest dokładnie odwrotnie. Bez rzetelnej identyfikacji partii i numerów seryjnych AI nie ma czego łączyć, a traceability staje się jedynie lepiej zorganizowanym chaosem. Technologia nie zastąpi podstawowej dyscypliny danych na poziomie linii.

Wsparcie w kwalifikacji dostawców i nadzorze nad nimi

Normy i regulacje wymagają systematycznej oceny dostawców: audyty, przeglądy KPI, monitorowanie jakości dostaw, terminowości, reklamacji. W praktyce wiele firm ogranicza się do rocznego raportu z kilkoma wskaźnikami. AI pozwala podejść do tego bardziej dynamicznie.

Modele oceny ryzyka dostawcy biorą pod uwagę nie tylko klasyczne KPI (odsetek niezgodnych dostaw, opóźnienia), ale też mniej oczywiste informacje: wzorce drobnych odstępstw, wyniki inspekcji wizualnych, raporty z audytów, nawet uwagi z korespondencji mailowej (przy zastosowaniu NLP i odpowiednich zabezpieczeń). W efekcie można wychwycić dostawcę „na krawędzi” problemu, zanim pojawi się poważna niezgodność lub zatrzymanie produkcji.

Przykładowo system zauważa, że w ostatnich miesiącach rośnie zmienność pewnych parametrów surowca, choć nadal mieści się w specyfikacji, a jednocześnie częściej pojawiają się drobne uwagi w zapisach z kontroli wejściowej. Dla człowieka to rozproszone sygnały, dla modelu – czytelny wzorzec rosnącego ryzyka.

AI pomaga też w planowaniu audytów dostawców. Zamiast corocznego harmonogramu „z rozpędu”, można ułożyć go według wyniku ryzyka: dostawcy o stabilnych wynikach są audytowani rzadziej i bardziej „lekko”, a ci z niepokojącymi trendami trafiają na listę priorytetową. To dobrze koresponduje z podejściem opartym na ryzyku (risk-based thinking) z ISO 9001 i wymogów branżowych.

Mit w tym obszarze jest prosty: „AI sama wskaże dobrych i złych dostawców”. Rzeczywistość jest taka, że AI porządkuje dane, ujawnia wzorce, ale ostateczna klasyfikacja i decyzje biznesowe nadal są po stronie zespołu jakości i zakupów. Zwłaszcza przy interpretacji wyników audytów czy kontekstu geopolitycznego nie ma jeszcze algorytmów zastępujących zdrowy rozsądek.

Ocena ryzyka operacyjnego i produktowego z użyciem modeli predykcyjnych

ISO 9001, ISO 14971 (dla urządzeń medycznych), IATF 16949 czy ISO 22000 wymagają podejścia opartego na ryzyku. Klasyczne FMEA czy HACCP opierają się na eksperckiej ocenie prawdopodobieństwa i skutków. AI wnosi do tego twarde dane: estymuje prawdopodobieństwo zdarzeń na podstawie historii procesów, awarii, reklamacji.

Modele predykcyjne uczone na danych z maszyn, testów jakości i danych serwisowych potrafią wyznaczyć prawdopodobieństwo wystąpienia określonego trybu uszkodzenia w zależności od kombinacji parametrów procesu i warunków pracy. Zamiast abstrakcyjnego „prawdopodobieństwo średnie”, otrzymujemy wartość, która wynika z faktycznych przypadków z przeszłości. FMEA przestaje być tylko warsztatowym ćwiczeniem, a zaczyna być żywym dokumentem karmionym realnymi danymi.

AI pomaga również w aktualizacji oceny ryzyka. System może np. co kwartał generować raport: które tryby uszkodzeń z FMEA w ogóle nie występują, a które pojawiają się częściej niż przewidywano. Wtedy komórka jakości ma podstawę do zmiany ocen RPN, dostosowania planów kontroli czy nawet modyfikacji konstrukcji.

Często powtarza się teza, że „AI wyeliminuje subiektywizm w ocenie ryzyka”. To złudzenie. Modele wnoszą dane i lepsze szacunki, ale nadal trzeba podjąć decyzję, jakie poziomy ryzyka są akceptowalne, jak reagować na rzadkie, ale bardzo poważne zdarzenia, które w danych pojawiły się tylko raz. Tu AI ma zbyt mało informacji, a znaczenie mają także czynniki regulacyjne, reputacja firmy i etyka.

AI a konkretne wymagania ISO 9001 – praktyczne przełożenie

ISO 9001 jest na tyle ogólna, że pozwala na szerokie zastosowanie AI – kluczowe jest logiczne powiązanie narzędzi z wymaganiami poszczególnych punktów normy. Kilka przykładów, jak przekuć to na język audytora:

- Kontekst organizacji (4.1, 4.2) – AI może analizować dane rynkowe, reklamacje i raporty serwisowe, aby identyfikować zmiany potrzeb klientów czy nowych interesariuszy. Raport z takiej analizy staje się wejściem do przeglądu zarządzania.

- Przywództwo (5.x) – pulpity dla zarządu oparte na AI pokazujące trendy jakości, ryzyka procesowego i satysfakcji klienta pomagają w „dowodach” zaangażowania kierownictwa opartego na danych, a nie tylko deklaracjach.

- Planowanie i ryzyko (6.x) – modele predykcyjne wspierają identyfikację ryzyk i szans, ale muszą być opisane jako narzędzie, a nie „decydujący organ”. W dokumentacji przydaje się klarowny opis, jakie decyzje podejmuje człowiek, a jakie rekomenduje algorytm.

- Wsparcie i zasoby (7.x) – AI można wprost potraktować jako „zasób infrastrukturalny” i „zasób wiedzy organizacyjnej”. Wtedy pojawia się obowiązek jego utrzymania, aktualizacji oraz ochrony przed utratą danych treningowych i modeli.

- Realizacja wyrobu (8.x) – tutaj wchodzą zastosowania SPC + AI, optymalizacja planów kontroli, traceability, nadzór nad dostawcami. Dla audytora ważne będzie, aby algorytmy były zintegrowane z istniejącymi procedurami, a nie tworzyły równoległego „dzikiego” systemu.

- Ocena wyników i doskonalenie (9–10) – AI jest idealnym narzędziem do analiz trendów, wykrywania powtarzalnych problemów, grupowania reklamacji i wspierania działań korygujących. W raportach z przeglądu zarządzania warto wprost zaznaczać, które wnioski pochodzą z analiz AI, a które z klasycznych metod.

Audytorzy często pytają o „dowody, że system AI jest pod kontrolą”. Dobrym ruchem jest przygotowanie dla każdego istotnego zastosowania krótkiej karty: cel, wejścia, wyjścia, odpowiedzialności, sposób walidacji i rewalidacji, sposób postępowania przy awarii modelu (fallback do manualnego trybu). To od razu oswaja temat i pokazuje, że nie mamy tu nieujarzmionej „czarnej skrzynki”, tylko normalne, nadzorowane wyposażenie.

AI a wymagania norm branżowych pokrewnych ISO 9001

W automotive, farmacji, spożywce czy urządzeniach medycznych AI musi wpisać się nie tylko w ISO 9001, ale też w normy sektorowe i przepisy. Kluczem jest dopasowanie poziomu formalizmu do rygoru danej branży.

IATF 16949 (automotive) stawia nacisk na prewencję, stabilność procesu i wymagania klientów OEM. AI świetnie pasuje do:

- rozszerzonego SPC (monitoring on-line, predykcja odchyłek),

- dynamicznych planów kontroli dostosowywanych do bieżącego ryzyka partii,

- analizy gwarancji i zwrotów serwisowych pod kątem powtarzalnych defektów.

Tu jednak każdy algorytm wpływający na decyzje o zwolnieniu partii lub zmianie parametrów procesu musi przejść walidację porównywalną do walidacji metod pomiarowych. Dla klientów motoryzacyjnych brak takiej walidacji będzie prostą drogą do niezgodności typu „major”.

ISO 13485 i MDR (wyroby medyczne) wymagają ścisłego nadzoru nad oprogramowaniem używanym w procesie wytwarzania i kontroli. Jeżeli AI wspiera decyzje jakościowe (np. automatyczna inspekcja obrazowa), trzeba ją traktować jak oprogramowanie wpływające na jakość wyrobu. Oznacza to pełną dokumentację wymagań, plan testów, walidację, kontrolę zmian i – co ważne – ocenę wpływu algorytmu na bezpieczeństwo pacjenta.

W przypadku gdy AI jest elementem wyrobu (Software as a Medical Device, SaMD), wchodzą dodatkowe wymagania dotyczące cyklu życia oprogramowania, zarządzania ryzykiem i monitorowania po wprowadzeniu na rynek. Modele uczące się po wdrożeniu (continuous learning) stanowią dodatkowe wyzwanie: każda zmiana modelu może być traktowana jak zmiana wyrobu, co ma bezpośrednie konsekwencje regulacyjne.

ISO 22000 i systemy HACCP (żywność) stawiają na bezpieczeństwo zdrowotne, identyfikowalność i kontrolę krytycznych punktów. AI może wspierać:

- predykcję ryzyka mikrobiologicznego na podstawie temperatur, wilgotności, czasu składowania,

- monitorowanie CCP w czasie rzeczywistym z detekcją nietypowych kombinacji warunków,

- analizę zgłoszeń konsumenckich pod kątem nowych typów zagrożeń.

Tu jednak nie ma przyzwolenia na eksperymenty „w ruchu produkcyjnym”. Każdy algorytm wpływający na decyzję o zwolnieniu partii musi być zweryfikowany przeciwko konserwatywnym, ustalonym metodom. AI może sugerować, ale sygnał „stop” musi być zdefiniowany i zrozumiały także bez modelu.

W farmacji dodatkowo dochodzą wymogi GxP i szczegółowe oczekiwania regulatorów (EMA, FDA) w zakresie walidacji systemów skomputeryzowanych (GAMP 5, Annex 11). Algorytm AI bywa traktowany jak złożony moduł systemu, który wymaga oceny krytyczności, walidacji w warunkach reprezentatywnych oraz nadzoru nad utrzymaniem wersji. Mit, że „regulatorzy nie pozwalają na AI”, jest w dużej mierze nieaktualny. Problemem nie jest sama AI, ale brak przejrzystego i udokumentowanego procesu jej projektowania, testowania i utrzymania.

Branżowe przykłady zastosowań AI w zgodności

Automotive: od predykcyjnej jakości po wymagania OEM

W przemyśle motoryzacyjnym AI najłatwiej przyjmuje się tam, gdzie już istnieją duże zbiory danych: linie montażowe, testy funkcjonalne, end-of-line, dane gwarancyjne. Przykładowy scenariusz to model, który na podstawie parametrów procesu z kilku etapów produkcji prognozuje prawdopodobieństwo wystąpienia defektu wykrywanego zwykle dopiero przy testach końcowych. Gdy ryzyko przekracza próg, partia trafia na rozszerzone testy lub dodatkowe inspekcje.

Takie podejście jest spójne z wymaganiami IATF 16949 w obszarze prewencji i z oczekiwaniami OEM co do obniżania PPM. Kluczowy element zgodności to jednak sposób wpięcia modelu w proces: musi istnieć procedura opisująca, kiedy AI może zmienić plan kontroli, kto zatwierdza te zasady, jak weryfikowany jest model i jak często następuje jego rewalidacja.

Drugie typowe zastosowanie to analiza danych z gwarancji i zwrotów serwisowych. AI grupuje podobne przypadki, wiąże je z konfiguracją pojazdu, dostawcami komponentów i konkretnymi partiami produkcyjnymi. Dla działu jakości to gotowe „mapy gorących punktów”, które można wykorzystać w działaniach korygujących i przeglądach FMEA. Z punktu widzenia audytora liczy się, że wnioski z takich analiz trafiają do formalnych zapisów (np. aktualizacji FMEA, planów kontroli, lekcji z reklamacji), a nie pozostają tylko w narzędziu analitycznym.

Farmacja: walidacja, GxP i nadzór nad danymi

W farmacji każdy system dotykający obszarów GxP musi być walidowany, a AI nie jest tu wyjątkiem. Typowe zastosowania to:

- monitoring warunków środowiskowych (temperatura, wilgotność, ciśnienie) w magazynach i na liniach, z predykcją ryzyka przekroczeń,

- analiza trendów danych analitycznych z laboratoriów QC, wykrywanie dryfu aparatury,

- wsparcie w przeglądzie zapisów (review by exception): system sygnalizuje tylko podejrzane serie wyników.

Przemysł spożywczy: od HACCP do predykcji incydentów jakościowych

W zakładach spożywczych AI zwykle startuje od prostego celu: szybciej wykrywać odchylenia i ograniczać straty surowca. Gdy spojrzeć na to oczami audytora ISO 22000 / HACCP, kluczowe jest pytanie: czy algorytm faktycznie wspiera kontrolę zagrożeń, czy jedynie „ładnie wizualizuje dane”.

Praktyczny przykład to system, który łączy dane z rejestratorów temperatury, wilgotności, czasu przetrzymywania półproduktu i danych z czyszczeń CIP. Model uczy się typowych wzorców pracy instalacji, a następnie sygnalizuje kombinacje parametrów, które historycznie poprzedzały incydenty jakościowe lub bliskie-missy (np. podwyższone wyniki drobnoustrojów). Dział jakości dostaje wcześniejsze ostrzeżenie i może zatrzymać proces przed realnym zagrożeniem dla bezpieczeństwa żywności.

Od strony zgodności z normą ważne są trzy elementy:

- powiązanie alertów AI z konkretnymi CCP / PRP (nie „ogólny alarm systemu”, ale np. „CCP1 – chłodzenie, ryzyko przekroczenia maksymalnego czasu w strefie niebezpiecznej”),

- jasne zasady postępowania po alarmie – kto reaguje, w jakim czasie, jakie decyzje są obowiązkowe niezależnie od oceny modelu,

- archiwizacja alarmów wraz z podjętymi działaniami, tak aby przy przeglądach HACCP można było pokazać efektywność systemu.

Dość popularny mit mówi, że „AI sama zoptymalizuje parametry procesu tak, by było i bezpiecznie, i tanio”. Rzeczywistość jest inna: minimalne limity bezpieczeństwa (np. temperatura obróbki, minimalny czas utrzymania) są nienaruszalne. Algorytm może jedynie szukać oszczędności powyżej tych progów, na przykład w lepszym planowaniu sekwencji produkcji czy redukcji niepotrzebnych postojów.

Coraz częściej AI pomaga też w analizie reklamacji konsumenckich. Narzędzia do przetwarzania języka naturalnego (NLP) grupują zgłoszenia wg typu produktu, partii, rodzaju problemu (ciała obce, smak, zapach, reakcje alergiczne). To pozwala szybciej wyłapać nowe typy incydentów, zanim staną się szerokim problemem rynkowym. Z perspektywy audytu istotne jest, aby ścieżka od „sygnału z AI” do „formalnego działania korygującego” była jasna, udokumentowana i powtarzalna.

Wyroby medyczne: system jakości a „uczące się” oprogramowanie

Firmy medtech często słyszą radę: „Nie róbcie AI, bo regulacje was zabiją”. To mocne uproszczenie. Regulacje rzeczywiście są wymagające, ale dobrze zorganizowana firma potrafi włączyć AI w istniejący system jakości ISO 13485 bez paraliżu organizacji.

Najczęstszy, stosunkowo prosty scenariusz to AI jako wsparcie procesu produkcji lub kontroli, np. system wizyjny klasyfikujący wady komponentów jednorazowych zestawów medycznych. W takim przypadku:

- AI jest traktowana jak oprogramowanie mające wpływ na jakość wyrobu – trafia pod procedury nadzoru nad oprogramowaniem i zmianą,

- wymagania funkcjonalne modelu (jakie wady ma wykrywać, przy jakiej granicy czułości i specyficzności) są opisane jak wymagania do klasycznego systemu wizyjnego,

- walidacja obejmuje porównanie z referencyjnym sposobem oceny (inspekcja manualna, uznana metoda pomiarowa) na reprezentatywnej próbie.

Większe wyzwanie zaczyna się przy wyrobach, w których AI jest sercem funkcji klinicznej – np. oprogramowanie wspomagające diagnostykę obrazową. Tu oprócz ISO 13485 wchodzą MDR, standardy typu IEC 62304 (cykl życia oprogramowania), ISO 14971 (zarządzanie ryzykiem) i wymagania nadzoru po wprowadzeniu na rynek.

Jednym z punktów zapalnych są modele, które mają się „uczyć w polu”. Często pojawia się przekonanie, że „system sam się poprawi z czasem”. Regulacyjnie wygląda to znacznie mniej romantycznie: każda istotna zmiana charakterystyki modelu (np. czułości diagnostycznej) może oznaczać konieczność formalnej zmiany wyrobu, z pełną oceną jej wpływu na bezpieczeństwo pacjenta. Rozsądnym kompromisem jest architektura, w której:

- model produkcyjny jest zamrożony na czas danej wersji wyrobu (brak samodzielnego uczenia on-line),

- dane z użycia w terenie trafiają do środowiska R&D, gdzie powstają udoskonalone wersje modelu,

- nowa wersja przechodzi kontrolowany proces weryfikacji / walidacji i dopiero potem – jako nowa wersja oprogramowania – jest wdrażana regulacyjnie.

Mit, że „regulatorzy nie rozumieją AI”, jest coraz mniej aktualny. Problem w praktyce polega raczej na tym, że firmy próbują przemycać modele jako „czarne skrzynki” bez jasnych wymagań, kryteriów wydajności i planu nadzoru. Gdy dokumentacja pokazuje logiczne powiązanie: dane wejściowe → przetwarzanie → wyjście → kontrola ryzyka, rozmowa z jednostką notyfikowaną czy regulatorem zwykle staje się znacznie prostsza.

Integracja AI ze środowiskiem GxP: farmacja i biotechnologia

W farmacji i biotechnologii sednem zgodności jest nie tylko efekt (niższe odchylenia, mniej OOS), ale także ścieżka dojścia – pełna śledzalność, kto co zrobił, kiedy i dlaczego. AI może tu działać bardzo skutecznie, ale wymaga podporządkowania się regułom GxP.

Dobrym punktem startu są systemy, które nie podejmują decyzji krytycznych, lecz wspierają ludzi w ich przeglądzie. Przykład: narzędzie AI analizuje zapisy z laboratoriów QC (wyniki, logi aparatury, komentarze analityków) i oznacza serie wymagające szczególnej uwagi – wykresy trendów zbliżające się do limitów, nietypowe wzorce odchyleń, powtarzające się komentarze dotyczące tej samej aparatury. Osoba odpowiedzialna za przegląd danych dostaje filtrowaną listę rekordów „podejrzanych” zamiast przeglądać całą masę zapisów.

Od strony GAMP / Annex 11 / 21 CFR Part 11 istotne są m.in.:

- kwalifikacja systemu jako GxP-relevant – określenie, czy AI ma wpływ na jakość produktu, bezpieczeństwo pacjenta i integralność danych,

- dobór kategorii oprogramowania wg GAMP (najczęściej system złożony, wymagający solidnej walidacji opierającej się na ryzyku),

- zapewnienie integralności danych wejściowych (ALCOA+): kto je wprowadza, czy źródła są chronione, czy transformacje danych są udokumentowane,

- śledzenie wersji modeli i zestawów danych treningowych, tak aby można było odtworzyć, na jakiej wersji działał system w danym momencie.

Błędem jest traktowanie AI jako „modułu analitycznego poza GxP”, gdy w rzeczywistości jego wyniki wpływają na decyzje dotyczące serii produkcyjnych. Jeżeli raport z AI skutkuje np. decyzją o dodatkowych badaniach serii, to regulator będzie oczekiwał, że proces powstawania tego raportu jest opanowany, zwalidowany i podlega kontroli zmian na równi z innymi systemami.

Architektura wdrożenia AI w systemie jakości: od PoC do produkcji

Znaczna część problemów ze zgodnością nie wynika z samej AI, lecz z chaotycznej ścieżki jej wdrażania. Typowy scenariusz: udany „dowód koncepcji” na danych historycznych, zachwyt nad wynikami, a potem szybkie podłączenie modelu do linii produkcyjnej bez przemyślanej architektury. Pierwszy audyt od razu wyłapuje brak kontroli nad zmianą, brak walidacji i brak dowodów na integralność danych.

Rozsądniej jest zaprojektować architekturę z myślą o wymaganiach jakości i regulacji od samego początku. Jej kluczowe elementy można streścić w kilku punktach.

Warstwa danych: jakość, śledzalność, kontekst

Modele AI są tak dobre, jak dane, którymi je karmimy. Z punktu widzenia ISO i przepisów branżowych dane muszą być nie tylko „duże”, ale przede wszystkim:

- zidentyfikowane – wiadomo, skąd pochodzą (system źródłowy, linia, stanowisko, urządzenie pomiarowe),

- zweryfikowane – istnieją mechanizmy wychwytywania błędów (braki, wartości skrajne, niezgodność jednostek),

- powiązane z kontekstem procesowym – partia, zmiana, operator, konfiguracja maszyny.

W praktyce oznacza to konieczność uporządkowania integracji między MES, SCADA, LIMS, ERP a platformą AI. Zgodność z normą często „wywraca” entuzjastyczne pomysły typu: zrzucimy wszystko do Data Lake i „coś z tego zrobimy”. Bez metadanych i słowników referencyjnych (np. jednoznacznych kodów przyczyn niezgodności) wyniki modeli są słabo audytowalne i trudne do obrony.

Warstwa modeli: zarządzanie cyklem życia AI

Drugi filar architektury to porządek wokół samych modeli. W świecie DevOps mówimy o MLOps; w świecie regulowanym dochodzi jeszcze wymiar compliance. Praktyczny minimalny zestaw elementów obejmuje:

- repozytorium modeli – z wersjonowaniem, opisem hiperparametrów, odwołaniem do zestawów danych treningowych i testowych,

- proces promowania modeli – od środowiska rozwojowego, przez testowe / walidacyjne, po produkcyjne, z kontrolą uprawnień i zatwierdzeń,

- monitoring działania – śledzenie jakości predykcji w czasie (drift danych, spadek dokładności) oraz reakcji użytkowników (jak często ludzie odrzucają rekomendacje modelu),

- plan rewalidacji – określone kryteria, kiedy model wymaga przeglądu lub ponownej walidacji (np. zmiana surowca, modernizacja linii, zmiana dostawcy).

Mit, że „sztuczna inteligencja się sama adaptuje”, w środowisku regulowanym staje się prostą drogą do niezgodności. W praktyce adaptacja oznacza kontrolowany proces aktualizacji modelu, zakończony formalnym dopuszczeniem do użycia – podobnie jak w przypadku zmiany algorytmu w klasycznym oprogramowaniu kontrolującym proces.

Warstwa procesów: AI wpisana w procedury i role

Od strony ISO 9001 i norm branżowych niezwykle ważne jest, by AI nie działała „obok systemu jakości”. Potrzebne są aktualizacje procedur, instrukcji i opisów ról, które jasno określą:

- kto odpowiada za nadzór nad danym systemem AI (właściciel procesu, właściciel systemu, właściciel modelu),

- w jakich decyzjach AI może tylko rekomendować (a człowiek zawsze zatwierdza), a w jakich może działać automatycznie,

- jak są dokumentowane odstępstwa – np. operator lub inżynier jakości może podjąć decyzję sprzeczną z rekomendacją AI, ale musi krótko uzasadnić powód.

Dobrą praktyką jest wprowadzenie prostych formularzy lub ekranów w systemie, gdzie przy każdym „ważnym” alarmie / rekomendacji użytkownik wybiera: „akceptuję – wykonano działanie X” albo „odrzucam – powód Y”. Taka informacja jest złotem zarówno dla doskonalenia modelu, jak i dla audytora, który chce zobaczyć, czy człowiek naprawdę zachował kontrolę nad procesem.

Warstwa bezpieczeństwa i dostępu: kto widzi co i dlaczego

W wielu branżach dane wykorzystywane przez AI to jednocześnie dane wrażliwe: produkcyjne (tajemnica przedsiębiorstwa), osobowe (np. operatorzy, pacjenci), a czasem zdrowotne (medyczne). Architektura systemu musi więc uwzględniać:

- kontrolę dostępu do danych i modeli (role, uprawnienia, zasada minimalnych uprawnień),

- rejestrowanie tego, kto uruchamia analizy, eksportuje raporty, zmienia konfigurację algorytmu,

- szyfrowanie danych w spoczynku i w transmisji, zwłaszcza gdy AI jest hostowana w chmurze,

- mechanizmy anonimizacji / pseudonimizacji tam, gdzie nie są potrzebne dane osobowe.

Brak tych elementów to jedna z pierwszych rzeczy, które wyłapują audytorzy przy okazji wdrożeń AI „w chmurze” w firmach farmaceutycznych czy medycznych. Nie chodzi tylko o bezpieczeństwo IT, ale o to, czy integralność i poufność danych są utrzymane na poziomie wymaganym przez normy i regulatorów.

Współpraca działu jakości, IT i biznesu przy wdrażaniu AI

AI w organizacji regulowanej to projekt interdyscyplinarny. Gdy jedna ze stron – jakość, IT lub biznes – „ciągnie koc” wyłącznie w swoją stronę, kończy się to często albo blokadą innowacji, albo wdrożeniem, którego nie da się obronić przed audytorem.

Dobrze działający model współpracy wygląda zazwyczaj tak:

- Biznes / operacje definiują problem (np. wysoka zmienność jakości, opóźnienia w kontroli, rosnąca liczba reklamacji) i wymagania funkcjonalne w języku procesu.

- Dział jakości / regulacji przekłada to na wymagania normatywne: które punkty normy są dotknięte, jaki poziom walidacji będzie wymagany, jakich zapisów trzeba będzie pilnować.

- IT / data science wybierają technologię, projektują architekturę i proces MLOps w taki sposób, aby spełnić zarówno oczekiwania biznesu, jak i wymogi jakości.

Najczęściej zadawane pytania (FAQ)

Jak AI pomaga utrzymać zgodność z normami ISO (9001, 14001, 45001) w praktyce?

AI przede wszystkim porządkuje i analizuje dane z procesów: parametry maszyn, wyniki kontroli, reklamacje, kwalifikacje personelu, zapisy z kalibracji. Zamiast ręcznie przeglądać tysiące rekordów, system wskazuje odchylenia, trendy i powtarzające się problemy, które mogą prowadzić do niezgodności z ISO.

W praktyce oznacza to wcześniejsze wykrycie ryzyka (np. rosnącej liczby drobnych reklamacji na konkretną linię) i szybsze działania korygujące. AI nie zastępuje wymagań norm, ale pomaga pokazać audytorowi, że proces jest faktycznie pod kontrolą, a nie tylko „dobrze opisany na papierze”.

Czym różni się „zwykła automatyzacja” od AI z punktu widzenia audytora ISO/FDA?

Klasyczna automatyzacja to z góry zapisane reguły typu „jeśli temperatura > X i ciśnienie < Y, zgłoś alarm”. Wszystko jest ręcznie zaprogramowane i łatwe do wytłumaczenia. AI (modele uczące się) nie ma sztywnej listy reguł – uczy się wzorców na podstawie danych historycznych i sama decyduje, co jest anomalią lub wadą.

Dla audytora kluczowe jest to, że przy AI trzeba udokumentować nie tylko logikę działania, ale również: dane treningowe, sposób walidacji, metryki skuteczności oraz zasady rewalidacji przy zmianach. Mit, że „audytor nie lubi AI”, zwykle bierze się stąd, że organizacja nie potrafi pokazać, jak nadzoruje model, a nie z samego faktu użycia algorytmów.

Czy stosowanie AI w systemie jakości jest akceptowane przez audytorów ISO, IATF, GMP, MDR?

Tak, pod warunkiem że AI jest zarządzana jak każde inne wyposażenie do monitorowania i pomiarów. Audytor oczekuje jasnego celu zastosowania, zdefiniowanego zakresu działania, walidacji, nadzoru nad zmianami oraz zapisów z wyników. To te same zasady, które dotyczą np. maszyny pomiarowej czy systemu wizji maszynowej.

Rzeczywistym problemem nie jest AI jako taka, tylko „czarna skrzynka bez właściciela”. Jeśli zakład potrafi w prosty sposób wyjaśnić, jakie dane zasilają model, jakie progi alarmowe przyjęto i jak wyniki wpływają na decyzje (np. blokadę partii, działania korygujące), audytor zwykle traktuje to jako mocny punkt systemu.

Jak opisać model AI w dokumentacji, żeby spełnić wymagania ISO 9001 / ISO 13485 / IATF 16949?

Najprościej potraktować model AI jak „wirtualnego operatora” lub specjalistyczne urządzenie pomiarowe. W procedurach i instrukcjach powinno się znaleźć: cel zastosowania (np. wykrywanie anomalii procesu), zakres (jakie linie, jakie produkty), źródła danych, kryteria akceptacji/odrzutu oraz odpowiedzialność za przegląd wyników i utrzymanie modelu.

Warto dodać opis walidacji (jak testowano model, jakie osiąga wyniki), sposób postępowania przy aktualizacji (nowe dane, nowe wersje modelu) oraz informację, gdzie przechowywane są zapisy z jego działania. Mit, że „AI jest nie do udokumentowania”, upada, gdy zaczniemy ją opisywać tym samym językiem, którym opisujemy systemy pomiarowe.

Czy do SPC i monitorowania procesu naprawdę potrzebna jest AI, skoro mamy Minitab i Excela?

Przy prostych, stabilnych procesach klasyczne SPC i arkusze kalkulacyjne w zupełności wystarczą. Problem zaczyna się przy wieloetapowej produkcji z setkami zmiennych, nieliniowymi zależnościami i opóźnionymi efektami (np. wpływ partii surowca sprzed tygodnia na bieżącą jakość). W takim środowisku „goły” Excel staje się loterią, a nie narzędziem nadzoru.

AI potrafi przetwarzać miliony rekordów z MES, SCADA, LIMS i QMS, wyłuskując subtelne wzorce, których nie widać na standardowych kartach kontrolnych. W efekcie zgodność z IATF, ISO 13485 czy GMP opiera się nie tylko na tym, że dane są zebrane, ale że ktoś (tu: model AI) faktycznie nad nimi czuwa.

Jak połączyć AI z istniejącymi systemami (ERP, MES, LIMS, QMS), żeby nie robić „równoległej rzeczywistości”?

Kluczową zasadą jest utrzymanie jednego „source of truth”. AI nie powinna tworzyć osobnych baz z własnymi wersjami danych, tylko pobierać informacje z systemów bazowych (ERP, MES, LIMS, QMS), analizować je, a wyniki – alarmy, rekomendacje, klasyfikacje partii – odsyłać z powrotem do tych samych systemów.

Przykład z praktyki: model wykrywania anomalii procesu korzysta z danych MES i SCADA, a informację o potencjalnej niezgodności zapisuje jako zdarzenie w QMS (np. potencjalna reklamacja wewnętrzna). Dzięki temu podczas audytu nie trzeba tłumaczyć dwóch równoległych światów – wszystko jest spójne z oficjalnymi zapisami.

Czy AI może zastąpić dokumentację wymaganą przez normy ISO i regulacje branżowe?

Nie. AI nie zwalnia z posiadania procedur, instrukcji, planów kontroli czy zapisów wymaganych przez normy i prawo. Jej rola polega na tym, aby dane z rzeczywistych procesów były spójne z tą dokumentacją i na bieżąco potwierdzały, że to, co zapisane, faktycznie działa na hali.

Mit, że „AI zrobi wszystko za nas”, jest równie szkodliwy jak mit „AI w audycie jest zakazana”. Rzeczywistość jest gdzieś pośrodku: najlepiej działają systemy, w których dobrze opisane procesy są wsparte twardymi, cyfrowymi dowodami z maszyn, laboratoriów i systemów jakości, analizowanymi właśnie przez AI.

Najważniejsze punkty

- Złożoność norm (ISO 9001, 14001, 45001, IATF, ISO 13485, GMP, HACCP, MDR, FDA itd.) przekroczyła możliwości „segregatora i Excela” – bez AI duża część danych produkcyjnych i jakościowych pozostaje niewykorzystana, a nadzór nad zgodnością jest tylko pozorny.

- Eksplozja danych z maszyn, systemów MES/SCADA/LIMS/QMS sprawia, że klasyczne SPC i arkusze kalkulacyjne przestają wystarczać; modele uczenia maszynowego wychwytują nieliniowe zależności, opóźnione efekty i subtelne korelacje, od których realnie zależy utrzymanie zgodności z wymaganiami ISO, IATF, GMP czy ISO 13485.

- Mit „zgodność to papierologia” rozmija się z praktyką – audytorzy coraz mniej ufają samym formularzom, a coraz bardziej patrzą na spójność danych z produkcji, laboratoriów i systemów reklamacji; AI pomaga przejść z deklaracji na dowody oparte na danych (data-driven compliance).

- AI umożliwia szybsze wykrywanie niezgodności i lepszą ocenę ryzyka, działając jak „dodatkowa para oczu” dla działu jakości: w kilka sekund analizuje wolumen danych, który człowiek obrabiałby dniami, dzięki czemu organizacja reaguje wcześniej, a nie dopiero przy reklamacji lub audycie.

- Mit, że „audytorzy nie lubią AI, bo to czarna skrzynka”, jest nieaktualny – to, co naprawdę się liczy, to transparentność: jasne źródła danych, sposób walidacji modeli, zdefiniowane progi alarmowe oraz udokumentowane wykorzystanie wyników w działaniach korygujących.

Bibliografia i źródła

- PN-EN ISO 9001:2015 Systemy zarządzania jakością – Wymagania. Polski Komitet Normalizacyjny (2016) – Podstawowe wymagania systemu zarządzania jakością

- PN-EN ISO 14001:2015 Systemy zarządzania środowiskowego – Wymagania i wytyczne stosowania. Polski Komitet Normalizacyjny (2016) – Wymagania środowiskowe istotne dla zgodności w przemyśle

- IATF 16949:2016 – Quality management system requirements for automotive production. International Automotive Task Force (2016) – Wymagania jakościowe branży motoryzacyjnej, powiązanie z ISO 9001

- ISO 13485:2016 Medical devices – Quality management systems – Requirements for regulatory purposes. International Organization for Standardization (2016) – Systemy jakości dla wyrobów medycznych, wymagania regulacyjne

- EU Regulation (EU) 2017/745 on medical devices (MDR). European Union (2017) – Regulacje MDR, wymagania dot. danych, nadzoru i zgodności

- 21 CFR Parts 210 and 211 – Current Good Manufacturing Practice for Finished Pharmaceuticals. U.S. Food and Drug Administration – Podstawowe wymagania GMP dla przemysłu farmaceutycznego